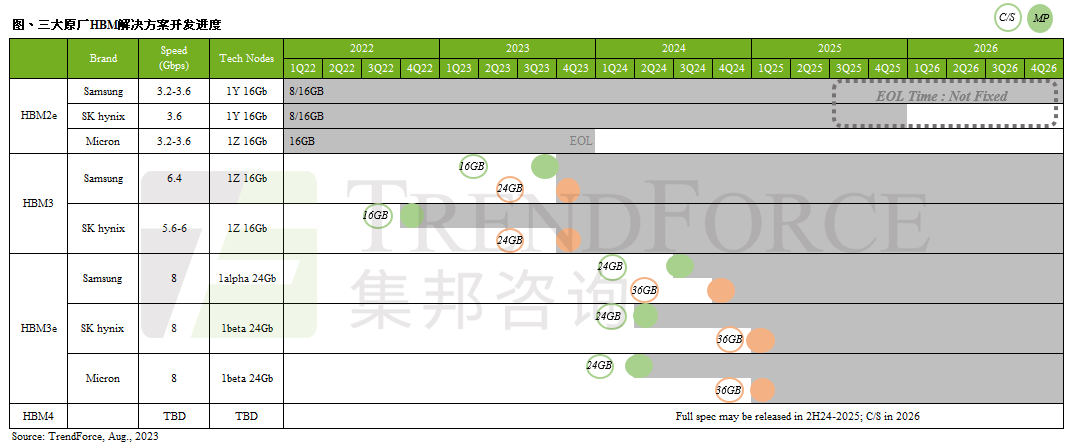

根据TrendForce集邦咨询调查显示,2023年HBM(High Bandwidth Memory)市场主流为HBM2e,包含NVIDIA A100/A800、AMD MI200以及多数CSPs自研加速芯片皆以此规格设计。同时,为顺应AI加速器芯片需求演进,各原厂计划于2024年推出新产品HBM3e,预期HBM3与HBM3e将成为明年市场主流。

HBM各世代差异,主要以速度做细分。除了市场已知的HBM2e外,在进入HBM3世代时,产业出现较为混乱的名称。TrendForce集邦咨询特别表示,目前市场所称的HBM3实际需细分为两种速度讨论,其一,5.6~6.4Gbps的HBM3;其二,8Gbps的HBM3e,别名HBM3P、HBM3A、HBM3+、HBM3 Gen2皆属此类。

目前三大原厂HBM发展进度如下,两大韩厂SK海力士(SK hynix)、三星(Samsung)先从HBM3开发,代表产品为NVIDIA H100/H800以及AMD的MI300系列,两大韩厂预计于2024年第一季送样HBM3e;美系原厂美光(Micron)则选择跳过HBM3,直接开发HBM3e。

HBM3e将由24Gb mono die堆栈,在8层(8Hi)的基础下,单颗HBM3e容量将一口气提升至24GB,此将导入在2025年NVIDIA推出的GB100上,故三大原厂预计要在2024年第一季推出HBM3e样品,以期在明年下半年进入量产。

CSP陆续启动自研AI加速芯片计划,欲摆脱对NVIDIA与AMD的依赖

观察AI服务器(AI server)所用的加速芯片,其中英伟达(NVIDIA)Server GPU市占最高。然而,单张20,000~25,000美元的H100/H800,一台AI服务器建议配置约为8张卡,也使得总体拥有成本(Total Cost of Ownership,TCO)大幅提升。TrendForce集邦咨询观察到,各云端服务业者(CSP)虽然仍会向NVIDIA或超威(AMD)采购Server GPU,但也同步进行自研AI加速芯片的计划。

除了已经推出的Google TPU与AWS Trainium和Inferentia外,Google与AWS正着手研发次世代自研AI加速芯片,将采用HBM3或HBM3e。TrendForce集邦咨询表示,其他包含北美及中国的云端服务业者亦有相关验证进行中,预期未来AI加速芯片版图竞争会更加激烈。

文章来源: TrendForce集邦